Mauvaises pratiques IA en entreprise - Le guide anti-arnaque

Vous ouvrez votre feed et c'est la foire. Trois posts plus bas, quelqu'un vous jure que l'IA va « révolutionner votre business » avec un prompt de quatre lignes et un carrousel aux teintes bleutées.

Mauvaises pratiques IA en entreprise : ce que les « experts » LinkedIn ne vous diront jamais

Cinq posts encore, un autre vous explique qu'il a « créé un agent IA » (spoiler : il a enchaîné trois automatisations dans un outil no-code). Lundi, ils « testent ». Mercredi, ils publient un « retour d'expérience ». Vendredi, ils « accompagnent les entreprises dans leur transformation IA ». Leur bio LinkedIn a changé trois fois en une semaine. Le secteur, lui, n'était pas au courant. Et tout ce petit monde se congratule mutuellement, pendant que vous, dirigeant de TPE, de PME ou indépendant, vous essayez sincèrement de comprendre comment cette technologie pourrait servir votre activité.

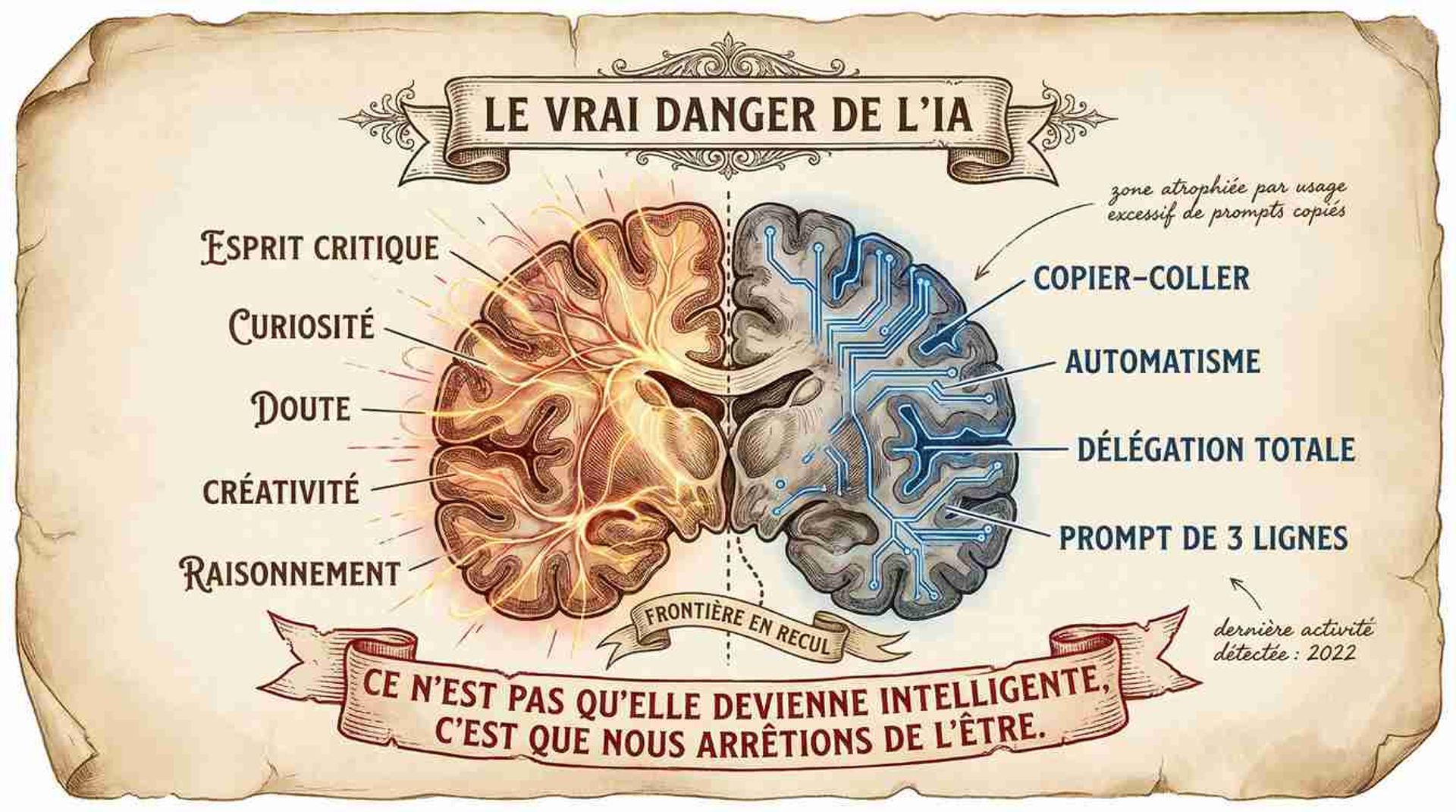

Le problème n'est pas l'IA. L'IA fonctionne, et elle peut réellement transformer votre quotidien professionnel. Le problème, ce sont les mauvaises pratiques IA en entreprise que ces pseudo-experts propagent à une vitesse affolante, sur LinkedIn, sur YouTube, dans des formations à 100 € qui recyclent les mêmes inepties copiées-collées du web anglophone. Et le risque est concret : vos équipes les croient. Elles appliquent ces conseils bancals. Elles obtiennent des résultats médiocres. Et elles finissent par conclure que « l'IA, ça ne marche pas pour nous ».

Cet article va démonter, une par une, les fausses croyances les plus répandues. Pas pour le plaisir de taper sur des influenceurs (quoique, avouons-le, c'est un bonus appréciable), mais parce que vous méritez une information fiable avant de prendre des décisions qui engagent votre entreprise, vos équipes et votre budget.

On y va. Et promis, pas de carrousel.

20 500 « experts IA » sur LinkedIn, et vous devriez vous méfier de la plupart

Le chiffre donne le vertige. Sur LinkedIn, on recense aujourd'hui plus de 20 500 profils se déclarant « experts » ou « spécialistes IA », et environ 11 000 « formateurs » ou « conférenciers IA ». Vingt mille. Pour une technologie dont l'outil grand public, ChatGPT, n'existe que depuis fin novembre 2022.

Faisons un calcul rapide. Les travaux du psychologue K. Anders Ericsson, popularisés par Malcolm Gladwell, estiment qu'atteindre un niveau d'expertise sur un sujet complexe demande environ 10 000 heures de pratique délibérée. Ça représente seize heures par jour, sept jours sur sept, pendant près de trois ans. Combien, parmi ces 20 500 profils, ont réellement accumulé ce volume de travail depuis 2022 ? Vous connaissez la réponse.

Avant le lancement de ChatGPT, seuls les développeurs employés dans des entreprises d'IA manipulaient réellement ces outils. Les autres n'y avaient tout simplement pas accès. Depuis, la plupart ont surtout « joué » avec l'IA, se nourrissant de recettes simplistes trouvées en ligne : des prompts courts, un rôle attribué au chatbot, quelques heures de vidéos YouTube. Et ils se sont déclarés prêts à facturer.

On pourrait objecter : « Mais l'autodidaxie, ça compte, non ? » Bien sûr que ça compte. Apprendre par soi-même, tester, échouer, recommencer, c'est une démarche respectable. Sauf qu'il y a une différence colossale entre un autodidacte rigoureux qui documente ses erreurs et un touriste enthousiaste qui confond veille Twitter et maîtrise technique. Le premier admet ce qu'il ne sait pas. Le second a déjà refait sa bio.

Ces chiffres révèlent ce que beaucoup de dirigeants soupçonnent sans oser le formuler : une armée d'imposteurs, attirés par la manne financière, avec une maîtrise empirique, ludique, sans compréhension des mécanismes réels de l'IA. Confier vos projets ou vos formations à ces profils, c'est prendre le risque de surestimer les capacités de la technologie, de sous-estimer ses limites, et de former vos équipes à des gadgets plutôt qu'à des méthodes. Le résultat ? Des mauvais choix dictés par la mode, et une fausse montée en compétences qui ne résistera pas au premier cas d'usage sérieux.

Si vous avez un doute sur votre propre niveau de maturité face à cette vague, un audit de maturité IA prend cinq minutes et coûte zéro franc. C'est toujours moins cher qu'un « expert » autoproclamé.

« Tu es mon expert en copywriting » : le mythe du rôle attribué à l'IA

« Tu es un expert en marketing digital. Rédige-moi un email de prospection pour mon service de coaching. » Vous avez forcément vu ce type de prompt. Sur YouTube, dans des formations en ligne, sur des carrousels LinkedIn partagés 4 000 fois. C'est le conseil numéro un que répètent les pseudo-experts depuis deux ans. Et c'est probablement le plus nocif de tous.

Pourquoi nocif ? Parce qu'il repose sur une incompréhension totale du fonctionnement de l'IA.

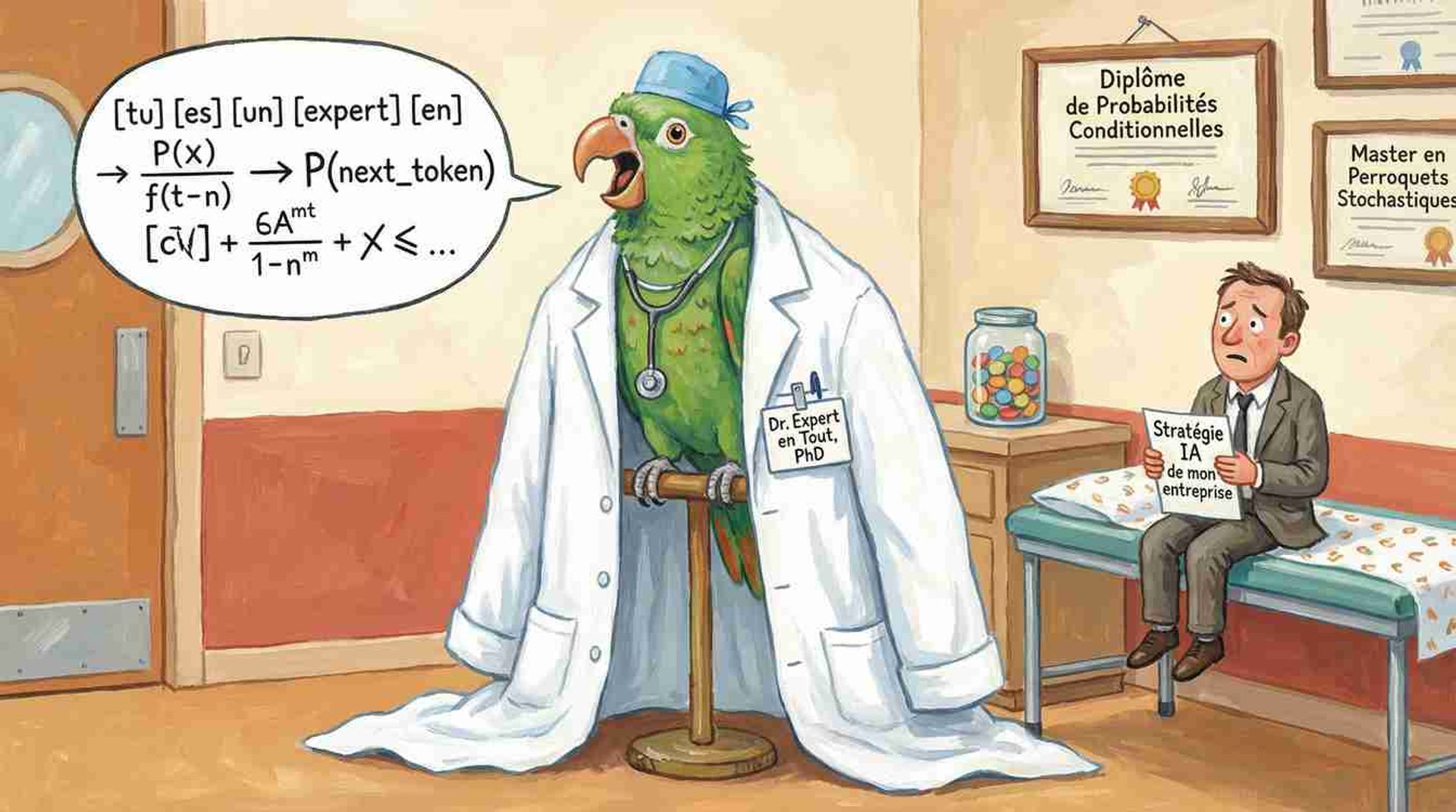

L'idée circule comme une évidence : si vous dites à ChatGPT qu'il est « expert en fiscalité suisse », il va miraculeusement acquérir les compétences d'un fiscaliste chevronné. Comme si écrire « tu es neurochirurgien » dans un prompt allait greffer un diplôme de médecine à un calculateur de probabilités. C'est absurde, mais c'est enseigné partout, y compris dans des formations facturées plusieurs centaines d'euros.

La réalité technique est bien moins romantique. L'IA fonctionne par tokenization : elle découpe votre texte en fragments (les tokens), les convertit en vecteurs mathématiques, puis calcule la probabilité statistique du mot suivant. Quand vous écrivez « Tu es un expert en copywriting. Rédige-moi un titre accrocheur », l'IA décompose cette phrase en une vingtaine de tokens. Sept d'entre eux, soit près de 40 %, n'apportent strictement rien au calcul : « tu », « es », « un », « en », « moi », « un ». Les mots « expert » et « copywriting » vont légèrement modifier le positionnement vectoriel de certains tokens dans le mécanisme d'attention, c'est vrai. Mais ça ne va pas transformer la machine en rédacteur publicitaire de talent. Ça va simplement orienter les probabilités vers un registre lexical et sémantiqe vaguement associé au marketing, et produire une réponse qui ressemble à du copywriting. Ressembler, pas en être.

Alors d'où vient cette confusion ? D'une mauvaise traduction, tout bêtement. Les modèles de langage utilisent trois rôles techniques dans leur architecture : « system », « user » et « assistant ». Le rôle system permet de définir des instructions de comportement pour l'IA (le ton, le format de réponse, les contraintes à respecter). Quelqu'un, quelque part, a confondu ce rôle technique avec l'idée qu'il fallait « attribuer un rôle » à l'IA, au sens de personnage. Et cette confusion s'est propagée comme une traînée de poudre, reprise par des milliers de « formateurs » qui n'ont jamais lu la documentation officielle d'OpenAI.

Et ce n'est pas qu'une intuition de praticien. La recherche scientifique le confirme noir sur blanc. Une étude de Carnegie Mellon et Stanford a testé 162 personas différents sur quatre familles de LLM, avec 2 410 questions factuelles. Le verdict est sans appel : attribuer un rôle n'améliore pas les performances du modèle. Dans certains cas, ça les dégrade. Une autre étude, publiée en 2024, va plus loin : elle démontre que les personas dégradent le raisonnement de l'IA dans un tiers des cas testés, y compris sur GPT-4. Leur titre résume tout : « Persona is a Double-edged Sword ». Quant au célèbre article de Bender et al., « On the Dangers of Stochastic Parrots », il rappelle ce que les pseudo-experts refusent d'entendre : un modèle de langage ne comprend rien, il calcule des probabilités de mots. Lui attribuer un rôle d'expert, c'est coller une blouse blanche sur un perroquet et espérer qu'il pose un diagnostic. La survey de référence de Carnegie Mellon sur les méthodes de prompting, citée des milliers de fois, ne mentionne d'ailleurs jamais l'attribution de rôle comme levier d'amélioration. Bizarre, non ?

Posez-vous la question autrement. Si attribuer un rôle changeait significativement la qualité de la réponse, qu'est-ce que ça révélerait ? Que votre prompt est creux là où ça compte. Un prompt professionnel, c'est une affaire de structure (l'ordre dans lequel vous présentez les informations a un impact direct sur le résultat), de précision des instructions, de format (un mélange de Markdown et de XML, par exemple, que la plupart des « formateurs » n'ont jamais manipulé), d'exemples concrets fournis à l'IA pour calibrer sa réponse. Et il y a des dizaines d'autres subtilités qu'on ne peut pas résumer dans un carrousel de cinq slides.

Autre angle mort que personne ne mentionne sur LinkedIn : un prompt qui « fonctionne » parfaitement dans ChatGPT produira des résultats médiocres dans Claude, et carrément ratés dans Gemini ou Mistral. Ces outils font tous la même chose en apparence, mais sous le capot, les technologies divergent. C'est comme comparer une voiture à boîte manuelle et une automatique : elles roulent toutes les deux, mais vous ne les conduisez pas de la même façon. Ceux qui vous vendent un « prompt universel qui marche partout » vous vendent, au mieux, une illusion.

Le conseil est donc limpide : arrêtez de tutoyer votre calculatrice en lui demandant de jouer au docteur. Donnez-lui des informations précises, structurées, riches de sens. C'est moins spectaculaire qu'un carrousel « Le prompt qui va changer votre vie », mais c'est ce qui fonctionne.

Prompts de 3 lignes, réponses de 3 sous : pourquoi le « simple » vous coûte cher

Demander à une IA de produire un travail de qualité avec un prompt de trois lignes, c'est comme envoyer un stagiaire en mission avec pour seul brief : « Fais un truc bien sur le projet machin ». Il va produire quelque chose, c'est certain. Mais vous n'allez pas aimer le résultat.

Et pourtant, c'est exactement ce que 99 % des prompts en circulation vous encouragent à faire. Allez sur Google, tapez « banque de prompts gratuits » ou « meilleurs prompts ChatGPT ». Vous tomberez sur des centaines de sites qui vous proposent la même recette, présentée comme un modèle à suivre : un peu de contexte (« je suis freelance en marketing »), un rôle (« tu es expert en… », on en a parlé), une tâche (« rédige-moi un email de prospection »). Le tout en trois à dix lignes. Emballé, c'est pesé.

Le résultat de ces prompts simplistes est mathématiquement prévisible, et il n'a rien de réjouissant. Vous vous souvenez du mécanisme : l'IA calcule la probabilité du prochain token en fonction des tokens présents dans votre prompt. Moins vous donnez d'informations riches et précises, plus l'IA se rabat sur les mots les plus probables. Or, « mot le plus probable » est un synonyme parfait de « mot le plus banal ». Vous obtenez donc, systématiquement, des réponses génériques, incomplètes, et dans environ 20 % des cas, factuellement fausses. Pas parce que l'IA dysfonctionne. Parce que vous ne lui avez rien donné pour travailler correctement.

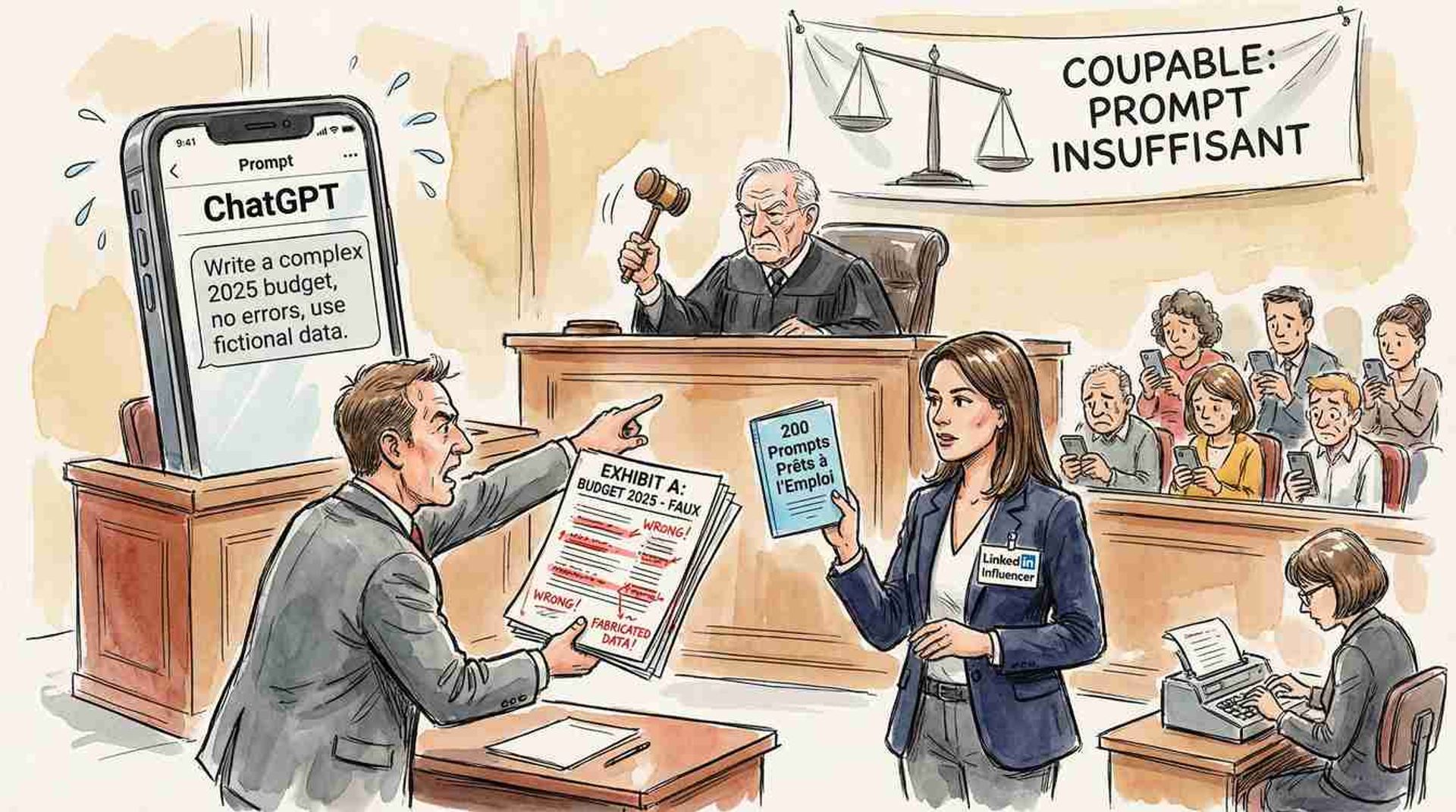

Prenons un cas concret. Un dirigeant de PME attache un document de 50 pages à sa conversation ChatGPT et tape : « Quel est le budget prévu pour 2025 ? » Le prompt est clair, non ? Sauf que l'IA ne « lit » pas votre document comme vous le lisez. Sans instructions détaillées sur comment parcourir le fichier, quoi chercher, comment distinguer une recommandation d'un montant validé, comment croiser les sources internes, elle va produire un chiffre. Sorti de nulle part, ou pire, sorti d'un passage qui mentionnait un tout autre contexte. Et vous, confiant dans la réponse, vous la glissez dans votre comité de direction. Le genre de scénario qui fait très mal le jour où quelqu'un vérifie.

Le mensonge le plus tenace dans tout ça ? L'idée que les prompts doivent être « les plus simples possibles, parce que l'IA est capable de réfléchir et de déterminer elle-même comment mener sa mission ». C'est faux. L'IA ne réfléchit pas. Elle ne raisonne pas. Elle enchaîne des calculs de probabilités. Et sans instructions structurées, détaillées, contextualisées, elle produira toujours le résultat le plus probable, c'est-à-dire le plus plat.

Mais ce discours-là, celui qui dit « c'est complexe, il faut apprendre, il faut structurer », ça ne rentre pas dans un carrousel de cinq slides. Ça ne fait pas de vues. Ça ne se vend pas en trois jours de formation avec un PDF de « 200 prompts prêts à l'emploi ». Alors on continue de vendre du simple. Et les entreprises continuent de croire que l'IA ne fonctionne pas pour elles, alors que c'est juste le mode d'emploi qui est bidon.

« J'ai créé un agent IA » (non, vous avez enchaîné trois prompts)

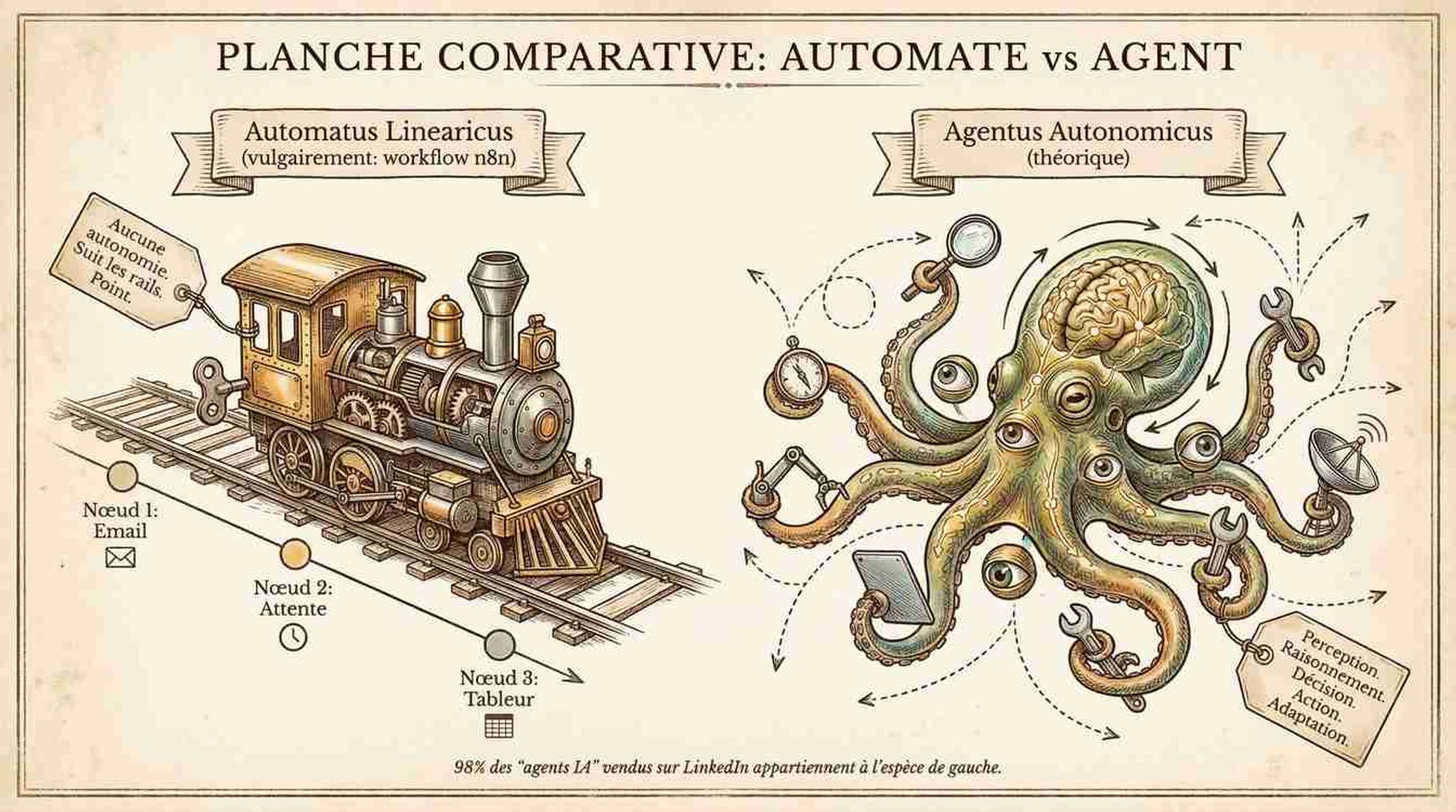

Non, votre workflow n8n n'est pas un agent IA. Il faut le dire, parce que visiblement personne ne le fait.

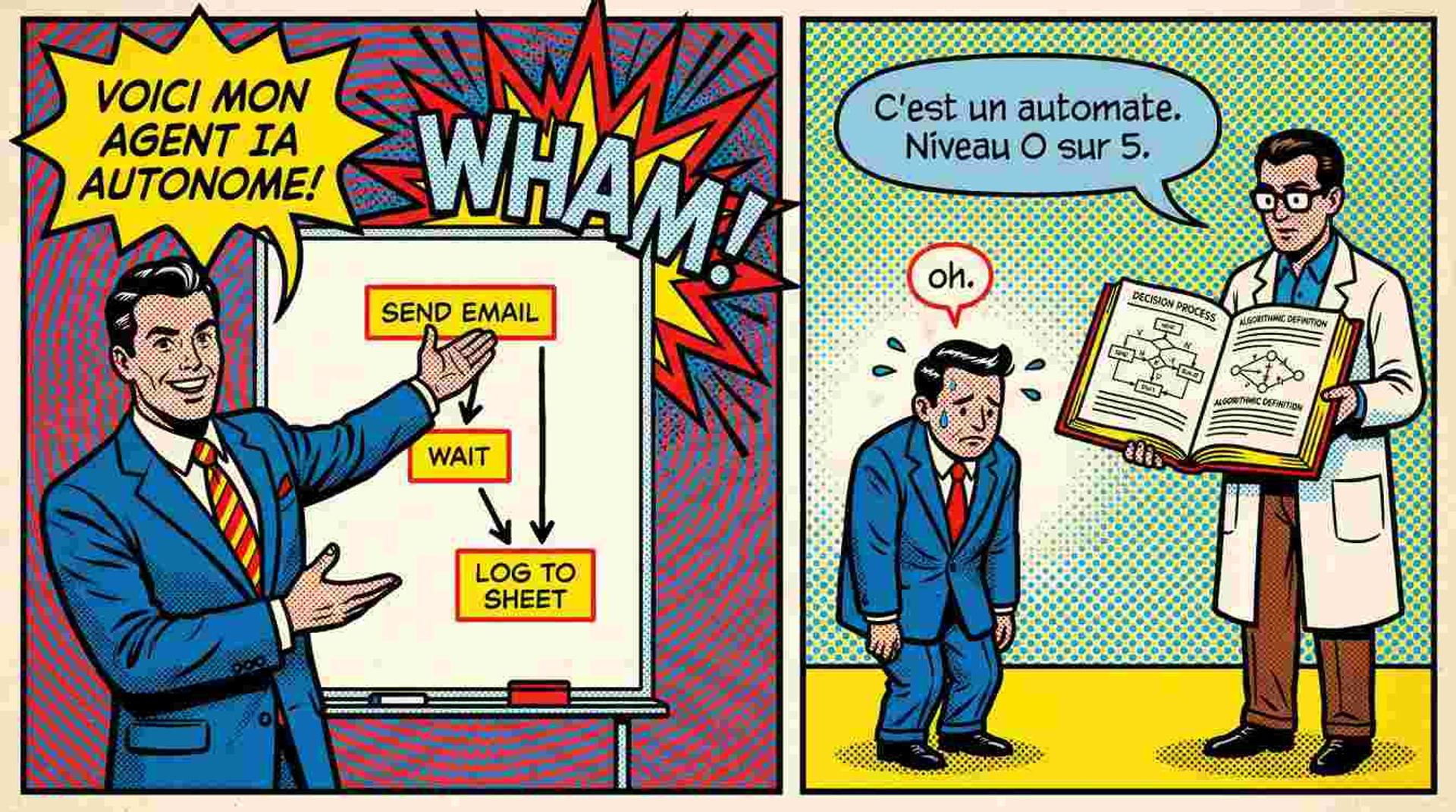

Un agent IA, au sens scientifique du terme, c'est une entité logicielle capable de percevoir son environnement, de raisonner sur ce qu'elle perçoit, de prendre des décisions autonomes, d'agir en conséquence, puis d'ajuster son comportement en fonction du retour qu'elle reçoit. Cette définition ne date pas d'hier : Wooldridge et Jennings l'ont formalisée en 1995, et la recherche actuelle la confirme encore. Une taxonomie récente classe même les agents en six niveaux d'autonomie, inspirés de la classification SAE pour les voitures autonomes. Le niveau 0 ? Zéro IA, juste un outil avec des boutons. C'est, à peu de choses près, ce que la plupart des « agents » vendus sur LinkedIn font réellement.

Parce que soyons précis sur ce qu'on observe sur le terrain. Un pseudo-expert vous montre un enchaînement de trois automatisations dans n8n ou Make. Le premier nœud envoie un email, le deuxième attend une réponse, le troisième classe le résultat dans un tableur. C'est utile, personne ne dit le contraire. Mais c'est un automate, pas un agent. La différence est fondamentale : un automate suit un chemin prédéfini, comme un train sur des rails. Un agent, lui, choisit son propre chemin. Il perçoit des obstacles, il recalcule, il adapte sa stratégie. Encapsulé dans un workflow ou enchaîné dans un GPT personnalisé, un prompt reste un prompt. Il n'acquiert ni autonomie, ni capacité d'action sur son environnement.

Et même les vrais agents, ceux développés par OpenAI, Google ou Anthropic avec des budgets colossaux, sont loin d'être fiables. Une étude de 2025 sur les systèmes agentiques en entreprise révèle que leur performance chute de 60 % lors d'un essai unique à 25 % quand on exige une cohérence sur huit exécutions consécutives. L'écart entre le laboratoire et la production atteint 37 %. Seules 10 % des entreprises parviennent à les déployer effectivement. Vous avez bien lu : les meilleurs agents du monde, développés par les plus grosses entreprises technologiques de la planète, échouent trois fois sur quatre en conditions réelles.

Alors quand un « formateur IA » vous annonce qu'il a créé un agent autonome avec un abonnement ChatGPT Plus et un tutoriel YouTube, posez-vous la bonne question. Ce n'est pas « comment il a fait ». C'est « pourquoi personne dans la salle ne rit ».

Le vocabulaire qui trahit l'imposteur (et les 10 signaux d'alerte)

Ce constat change tout pour la suite. Si les rôles attribués ne fonctionnent pas, si les prompts simplistes produisent du vide, si les « agents IA » vendus sur LinkedIn ne sont que des automates maquillés, alors comment repérer ces imposteurs avant de leur confier votre projet ou votre budget formation ?

La bonne nouvelle, c'est qu'ils se trahissent presque tous seuls.

Observez leur vocabulaire. Les faux experts IA ont deux obsessions : capter l'attention et vendre. Leur langage porte les stigmates d'une connaissance superficielle, souvent nourrie par l'IA elle-même. Ils écrivent « prompt ultime » (traduit mot à mot de l'anglais « ultimate prompt », une expression qu'aucun ingénieur sérieux n'emploie), ils qualifient chaque outil de « game changer » (sans jamais expliquer quel jeu a changé exactement), ils empilent les adjectifs creux : « puissant », « ULTRA efficace », « révolutionnaire ». Leurs visuels ? Des images générées par IA aux teintes bleut-violettes obligatoires dès que le sujet touche au digital. Le fond et la forme trahissent la même chose : l'absence de compréhension réelle.

Mais le vocabulaire n'est qu'un indicateur parmi d'autres. En croisant nos observations de terrain avec celles de formateurs reconnus, nous avons identifié dix signaux récurrents chez ces imposteurs. La présence d'un seul devrait suffire à éveiller votre méfiance.

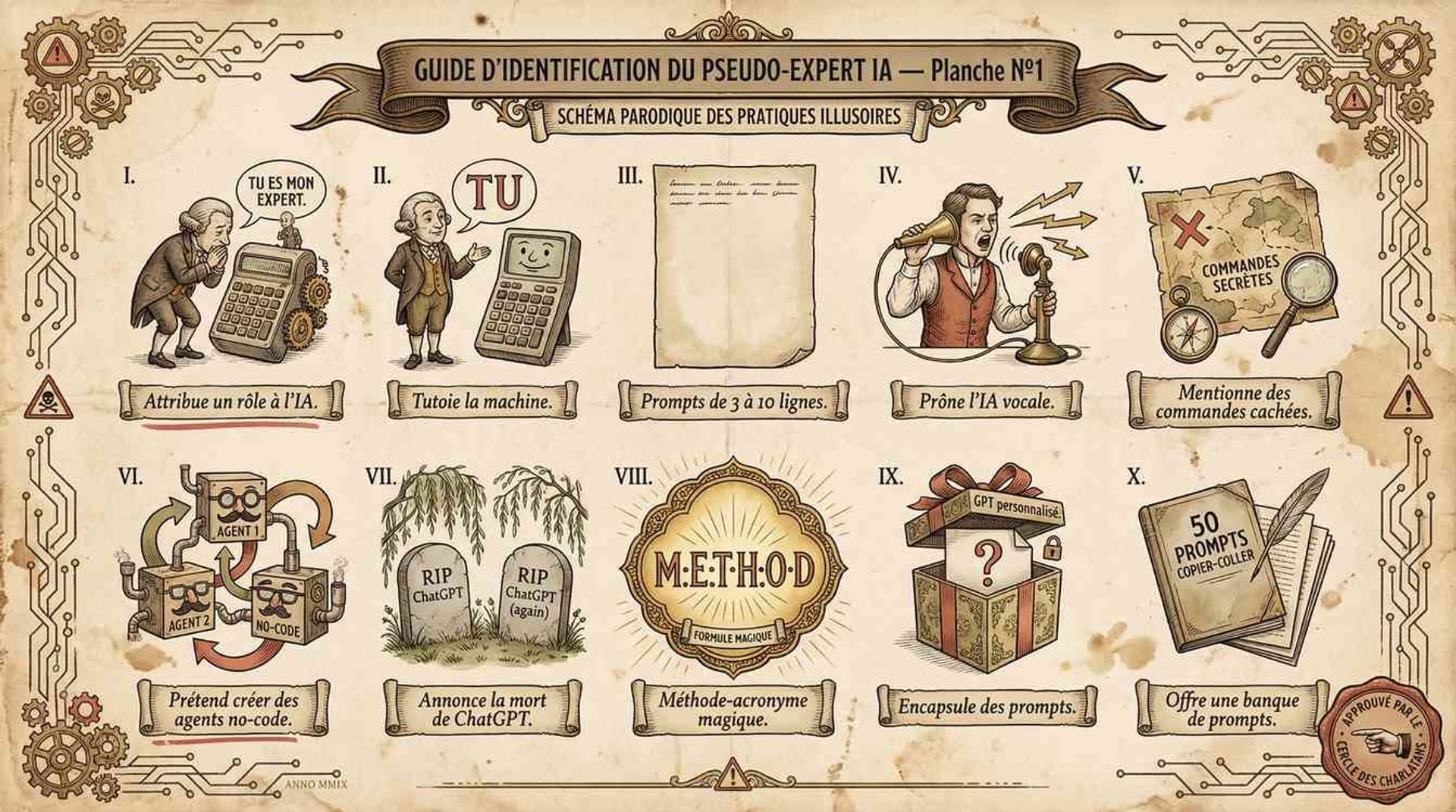

Le premier est le plus flagrant : le prestataire préconise d'attribuer un rôle à l'IA (on a démontré pourquoi c'est inefficace). Le deuxième coule de source : il tutoie l'IA, comme si la politesse influençait un calcul matriciel. Le troisième concerne la longueur de ses prompts, systématiquement entre trois et dix lignes, là où un travail sérieux en exige souvent dix fois plus. Quatrième signal : il prône l'IA vocale comme méthode de travail productive (essayez de dicter un prompt structuré de 200 lignes à voix haute, vous comprendrez le problème). Cinquième : il mentionne des « commandes cachées » de l'IA, un concept qui n'existe tout simplement pas dans l'architecture des LLM.

Sixième signal, on vient d'en parler : il prétend créer des agents IA avec des outils no-code. Septième : il annonce régulièrement « la mort de ChatGPT » au profit du dernier modèle à la mode, sans comprendre que les architectures sous-jacentes sont fondamentalement similaires. Huitième : sa méthode tient dans un acronyme de cinq ou six lettres, un habillage marketing censé résumer une discipline qui fait l'objet de milliers de publications scientifiques. Neuvième : il préconise les GPT personnalisés ou les « instructions personnalisées » comme des fonctionnalités majeures, alors qu'il ne s'agit que de prompts encapsulés (on y revient toujours). Et dixième, le plus révélateur peut-être : il vous offre une « banque de prompts » de quelques pages, comme si l'efficacité avec l'IA se résumait à un copier-coller.

Vous voulez un raccourci ? Demandez-leur simplement un exemple de prompt qu'ils utilisent en production. S'il tient en dix lignes, vous avez votre réponse.

Le contraste avec un praticien sérieux est saisissant. Quelqu'un qui travaille réellement avec l'IA depuis des années ne se déclare pas « expert ». Il lit des publications sur arXiv et ResearchGate, pas des threads Twitter. Il a mis les mains dans le code bien avant que ChatGPT n'existe, parfois depuis l'époque où GPT-2 tournait en open source dans un terminal Python. Il connaît la différence entre un réseau convolutif et un transformer, parce qu'il a codé les deux. Et quand on lui demande ce qu'il fait, il répond qu'il sait utiliser l'IA de manière efficiente, responsable et éthique, pas qu'il va « révolutionner votre business en 48 heures ». Ce profil-là ne crie pas sur LinkedIn. Il travaille. Et c'est précisément à ce type de praticien qu'il faut confier vos projets, pas à celui qui a refait sa bio trois fois cette semaine.

Je ne me déclare pas « expert IA » dans le sens académique. Je sais utiliser cet outil de manière efficiente, responsable et éthique, et c'est exactement ce que j'enseigne à mes clients. Entre quelqu'un qui a découvert l'IA sur un carrousel LinkedIn en 2023 et quelqu'un qui a codé son premier réseau de neurones quand l'autre apprenait encore à ouvrir un navigateur, la différence ne se lit pas sur une bio. Elle se perçoit dès les premières minutes d'échange, dans la précision des réponses, dans l'honnêteté sur les limites, dans la capacité à dire « non, l'IA ne fera pas ça pour vous » plutôt que de vendre une promesse creuse. Si vous avez un doute sur votre prestataire actuel, ou si vous voulez simplement y voir plus clair avant d'engager du budget, un appel découverte vaut mieux qu'un énième carrousel.

Pour évaluer concrètement vos prestataires, nos services incluent une grille d'évaluation détaillée que vous pouvez appliquer à tout consultant, formateur ou agence qui prétend vous accompagner sur l'IA.

Comment un dirigeant peut (vraiment) adopter l'IA sans se faire plumer

Et si le problème n'avait jamais été l'IA ? Si le vrai frein, depuis le début, c'étaient ceux qui vous la vendent mal ?

Parce que la situation est paradoxale. La technologie fonctionne. Elle produit des résultats concrets, mesurables, dans des entreprises de toutes tailles. Des PME suisses gagnent déjà des heures chaque semaine sur leurs tâches administratives, leur production de contenu, leur analyse de données internes. Mais pour chaque entreprise qui réussit son adoption, combien ont claqué du budget dans une formation inutile, bricolé avec des prompts copiés du web, et fini par conclure que « l'IA, c'est pas pour nous » ? Trop. Beaucoup trop.

Le schéma est presque toujours le même. Un dirigeant entend parler de l'IA partout, sent qu'il prend du retard, tape « formation IA entreprise » dans Google, tombe sur le premier résultat sponsorisé, paie, suit trois heures de vidéo, reçoit un PDF de prompts, et se retrouve exactement au même point qu'avant. Sauf qu'il a dépensé de l'argent et, pire, qu'il croit maintenant avoir « essayé l'IA ». Il n'a rien essayé du tout. Il a suivi un mauvais guide.

La leçon tient en une phrase : l'adoption de l'IA dans une entreprise n'est pas un achat, c'est un processus. Et ce processus commence toujours par la même étape, celle que personne ne veut entendre parce qu'elle ne se vend pas en trois slides : comprendre où vous en êtes vraiment. Pas où vous pensez en être. Pas où votre concurrent prétend en être sur LinkedIn. Où vous en êtes, concrètement, avec vos données, vos processus, vos équipes, vos vrais besoins métier.

C'est exactement la raison pour laquelle nous avons conçu notre audit de maturité IA comme un point de départ, pas comme un produit d'appel. Cinq minutes, zéro franc, et vous repartez avec un diagnostic honnête de votre situation. Pas un score bidon suivi d'un « contactez-nous pour en savoir plus ». Un vrai état des lieux, avec des recommandations actionnables que vous pouvez appliquer seul si vous le souhaitez.

Et si l'audit révèle que vous avez besoin d'accompagnement, alors seulement, on parle de formation sur mesure adaptée à votre métier, à vos cas d'usage réels, à votre niveau de maturité. Pas une formation générique de plus. Une formation où vos équipes repartent capables de structurer un prompt de 200 lignes, de comprendre pourquoi l'IA répond ce qu'elle répond, et de détecter quand elle raconte n'importe quoi. Le genre de compétence qui ne s'apprend pas dans un carrousel.

Demain matin vous ouvrirez LinkedIn

Votre feed n'aura pas changé. Le même carrousel « 5 prompts qui vont révolutionner votre business » tournera encore, partagé par quelqu'un qui a découvert ChatGPT il y a dix-huit mois et se présente déjà comme « stratège IA ». Le même webinaire gratuit promettra de « maîtriser l'intelligence artificielle en 45 minutes ». Le même post viral expliquera qu'un « agent IA no-code » a remplacé trois employés (spoiler : c'est un workflow avec cinq nœuds et aucune autonomie).

Vous pouvez scroller. Vous pouvez même liker, par politesse ou par habitude. Mais au moins, maintenant, vous savez ce qui se cache derrière le rideau. Vous savez que 20 500 « experts » autoproclamés ne font pas une expertise. Que tutoyer une IA ou lui attribuer un rôle ne relève pas de la stratégie, mais du folklore. Que trois lignes de prompt produiront toujours une réponse médiocre, quel que soit l'outil. Et qu'un automate qui enchaîne des étapes prédéfinies n'a jamais été un agent, quoi qu'en dise la page de vente.

L'IA fonctionne. Vraiment. Pas comme la promettent les charlatans, pas comme la craignent les sceptiques, mais comme un outil puissant qui exige du sérieux, de la méthode et une honnêteté que ce marché a cruellement perdue en route.

La question n'est plus de savoir si votre entreprise doit adopter l'IA. C'est de savoir avec qui.

Et cette réponse commence par cinq minutes : celles de votre audit de maturité IA, gratuit, sans engagement, sans carrousel en bonus.